深度神经网络在视觉分类任务上表现出卓越的性能,但其安全性也面临着重大挑战,特别是分类器的输出结果容易受到对抗攻击的恶意操纵。为应对此问题,对抗训练(Adversarial Training)作为一种有效的防御机制得到了快速发展。然而,现有对抗训练方法大多依赖于白盒防御策略,即需要访问模型的结构参数并对模型进行重新训练,这在许多实际应用场景中并不切实际,尤其是对于大规模预训练模型的鲁棒性增强。为了解决上述问题,本实验室师生提出了一种全新的贝叶斯能量对抗后训练策略,通过从能量角度建模联合概率分布并采用后训练贝叶斯策略进行优化。该方法无需了解预训练模型,不仅可以在不损害模型精度的前提下有效提升模型的鲁棒性表现,还显著降低了资源开销。

近日,本实验室青年教师刁云峰以第一作者发表题为“基于贝叶斯能量对抗后训练的黑盒对抗防御方法”的高水平论文工作发表于计算机学会(CCF)推荐T1类期刊《中国科学: 信息科学》,本实验室本科生姜凯超为第二作者,郭丹教授为通讯作者。该项工作由合肥工业大学与复旦大学、国防科技大学合作完成。

论文简介:

论文标题:

基于贝叶斯能量对抗后训练的黑盒对抗防御方法

论文作者:

刁云峰, 姜凯超, 郭丹, 梁振宇, 时增林, 钱振兴, 汪萌

论文链接:

https://doi.org/10.1360/SSI-2024-0326

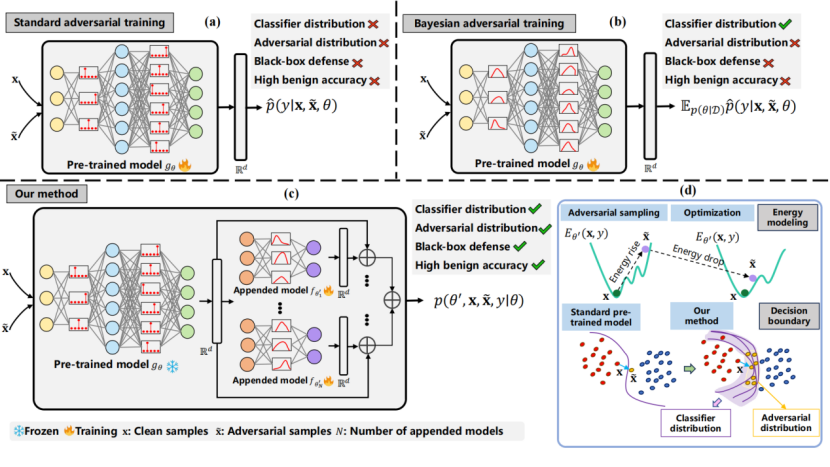

图1 贝叶斯能量对抗后训练的框架示意图

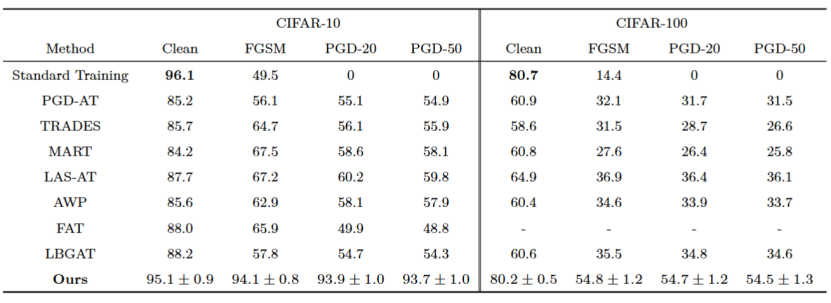

表 1 APLT与传统半监督方法性能对比

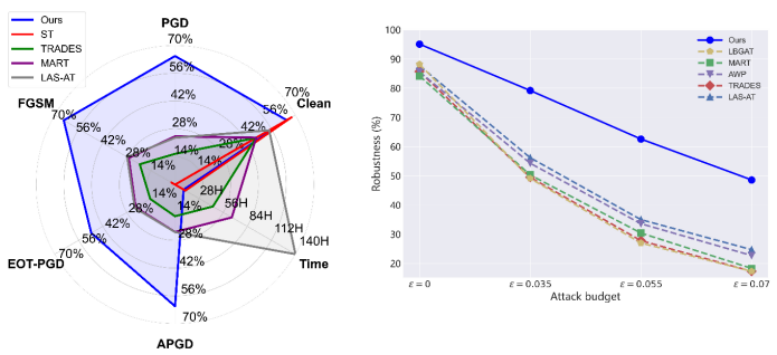

图2(左图):使用ResNet-18在ImageNet子集上进行鲁棒性比较;(右图):使用WideResnet28-10在CIFAR10上进行不同EOT-PGD攻击扰动下的鲁棒性比较

为了解决现有对抗训练因依赖白盒防御策略且以牺牲模型精度为代价换取鲁棒性提升,而难以应用于大规模预训练模型和高精度分类任务的难题,该论文提出一种全新的贝叶斯能量对抗后训练策略,通过对干净样本分布、对抗样本分布和模型的参数分布进行联合概率分布建模,实现了对于数据和模型的全贝叶斯对待。同时该方法采用后训练贝叶斯策略进行优化,在冻结的预训练模型后面附加一个小规模的贝叶斯模型单元,并仅对该单元进行鲁棒优化。该方法不仅保留了预训练模型的完整性,还显著降低了资源开销,在实际应用中的灵活性更高。为评估模型的鲁棒性表现,本文在3个数据集、4种基线模型上评估了共计13种对抗攻击方法的防御表现。大量实验结果表明,该方法在面对基于梯度的白盒对抗攻击和黑盒对抗攻击时,能够在保持模型原始精度的同时显著提升鲁棒性,其鲁棒性甚至优于现有的白盒防御方法。特别是在大扰动强度的极端条件下,本方法相比于现有的对抗训练方法有显著的鲁棒性优势。

《中国科学: 信息科学》是中国科学院和国家自然科学基金委员会共同主办的学术刊物,力求刊载信息学科领域最高学术水平的中文文章,是中国计算机学会(CCF)、中国自动化学会(CAA)、中国通信学会(CIC)和中国人工智能学会(CAAI)推荐的A/T1类期刊。

情感计算与先进智能机器安徽省重点实验室

2025年8月4日

科研动态

科研动态 2025-08-04

2025-08-04

安徽省合肥市蜀山区丹霞路485号(合肥工业大学翡翠湖校区)

安徽省合肥市蜀山区丹霞路485号(合肥工业大学翡翠湖校区) aflab_hfut@163.com

aflab_hfut@163.com