多媒体内容分析与检索领域再迎重磅突破!本重点实验室研发的MRNet系统,像一位能听懂人话的“智能剪辑师”,能在海量视频中精准定位你描述的那个瞬间。这项技术为视频理解装上了“双重视角”:既能像RNN一样理解时间的前因后果,又能像Transformer一样高效并行运算。在五大国际标准测试中,MRNet的定位准确率大幅领先,尤其在复杂长视频中,检索精度提升高达12.86%,推理速度更是比现有方法快1.65倍。快来体验这场视频检索的“精准定位”革命吧!

本重点实验室在多媒体内容分析与检索领域取得重要突破,相关论文被多媒体领域顶级国际会议ACM MM 2024接收。该研究针对视频时刻检索任务中视频时序建模复杂、跨模态语义引导不足两大核心挑战,提出了一种名为“可掩蔽保留网络(MRNet)”的全新框架。该项工作由合肥工业大学、合肥综合性国家科学中心人工智能研究所为主要完成单位,本重点实验室2024级博士研究生胡晶晶为该项成果的第一作者,郭丹教授和汪萌教授为通讯作者。ACM MM是多媒体领域的旗舰会议,也是中国计算机学会(CCF)推荐的A类国际会议。

论文简介:

论文标题:Maskable Retentive Network for Video Moment Retrieval

论文作者:Jingjing Hu, Dan Guo, Kun Li, Zhan Si, Xun Yang, Meng Wang.

论文链接:https://dl.acm.org/doi/10.1145/3664647.3680746

论文概述:

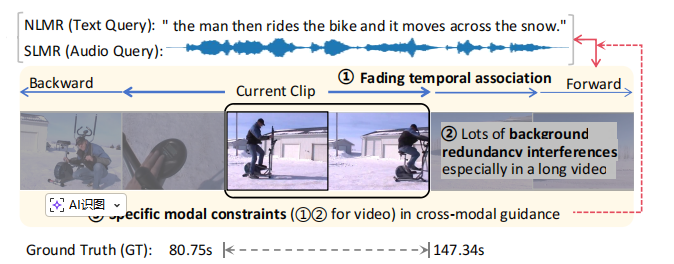

图1 视频时刻检索的关键挑战与解决方案示意图

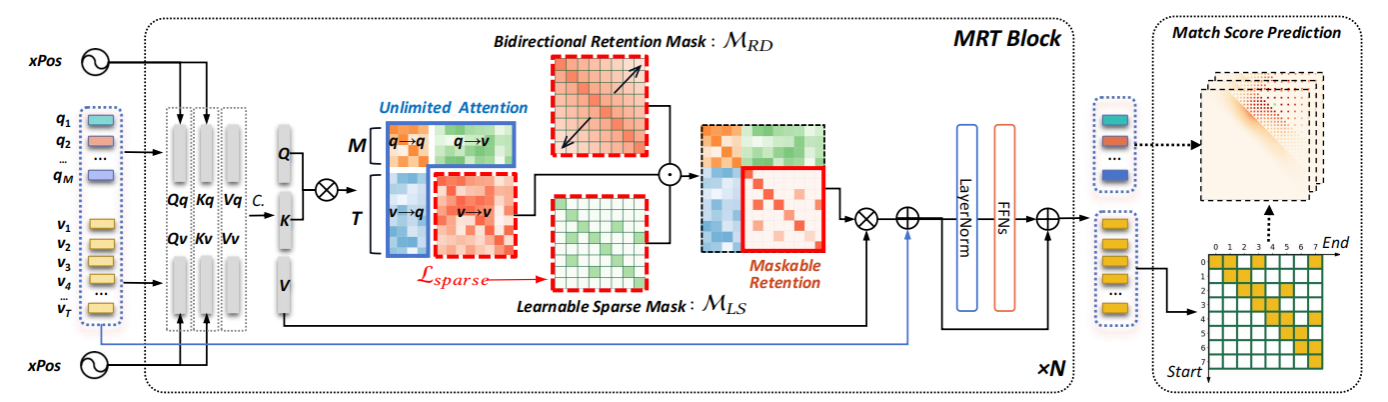

图2 可掩蔽保留网络(MRNet)体系结构的概述

视频时刻检索(MR)旨在根据自然语言或语音查询,从未修剪的视频中定位目标时刻。本文提出了一种新颖的可掩蔽保留网络(MRNet),以应对MR任务中的两大挑战:跨模态引导和视频序列建模。MRNet在多模态Transformer中引入保留机制,并采用模态特定的注意力模式。具体而言,对语言相关区域采用无限制注意力以最大化跨模态交互;对纯视频区域则提出可掩蔽保留机制,通过双向衰减保留掩码显式建模视频片段间的时序依赖,并利用可学习的稀疏保留掩码自适应捕捉与查询相关的关键语义关联,同时设计自监督稀疏损失以消除冗余响应。在ActivityNet Captions、TACoS、Charades-STA、ActivityNet Speech和QVHighlights五个基准数据集上的大量实验表明,MRNet在自然语言、语音检索及联合任务上均显著超越了现有最先进方法,实现了性能与效率的最佳平衡。

ACM MM全称为ACM Multimedia,是由国际计算机协会(ACM)主办的顶级国际学术会议,始终是多媒体领域的风向标与最高学术殿堂。作为中国计算机学会(CCF)认定的A类国际会议,ACM MM 聚焦多媒体计算、分析、检索、交互等前沿研究方向,其接收的论文代表着多媒体领域最新的研究成果与技术发展趋势,成果的发表充分彰显了我院在多媒体内容分析与检索领域的研究工作已达到国际领先水平。

情感计算与先进智能机器安徽省重点实验室

2026年3月15日

科研动态

科研动态 2026-03-15

2026-03-15

安徽省合肥市蜀山区丹霞路485号(合肥工业大学翡翠湖校区)

安徽省合肥市蜀山区丹霞路485号(合肥工业大学翡翠湖校区) aflab_hfut@163.com

aflab_hfut@163.com